Tópicos populares

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

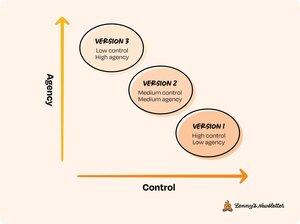

"No desenvolvimento de software tradicional, você planejava a v1, v2, v3 do novo produto com base na profundidade de recursos ou nas necessidades dos usuários. Com sistemas de IA, a perspectiva muda.

Cada versão é definida, em vez disso, pela quantidade de autonomia que o sistema possui e quanto controle você está disposto a abrir mão.

Comece identificando um conjunto de recursos que têm alto controle e baixa autonomia (versão 1 na imagem abaixo).

Esses devem ser pequenos, testáveis e fáceis de observar. A partir daí, pense em como essas capacidades podem evoluir ao longo do tempo, aumentando gradualmente a autonomia, uma versão de cada vez. O objetivo é decompor um estado final ambicioso em comportamentos iniciais que você pode avaliar, iterar e construir a partir deles.

Por exemplo, se seu objetivo final é automatizar o suporte ao cliente em sua empresa, uma maneira de alto controle para começar seria definir a v1 (versão 1) como simplesmente direcionar tickets para o departamento certo, depois passar para a v2 onde o sistema sugere possíveis resoluções, e somente na v3 permitir que ele resolva automaticamente com uma opção de fallback humano.

Aqui estão mais alguns exemplos:

Assistente de marketing

v1: Redigir e-mail, anúncio ou texto para redes sociais a partir de prompts

v2: Criar campanhas de múltiplas etapas e executá-las

v3: Lançar, testar A/B e otimizar automaticamente campanhas em diferentes canais

Assistente de codificação

v1: Sugerir conclusões inline e trechos de código padrão

v2: Gerar blocos maiores (como testes ou refatorações) para revisão humana

v3: Aplicar mudanças específicas e abrir pull requests (PRs) de forma autônoma

Se você acompanhou como ferramentas como GitHub Copilot ou Cursor evoluíram, este é exatamente o manual que eles usaram. A maioria dos usuários só vê a versão atual, mas o sistema subjacente subiu essa escada gradualmente. Primeiro conclusões, depois blocos, depois PRs, com cada passo conquistado através de uso, feedback e iteração."

Mais aqui:

20/08/2025

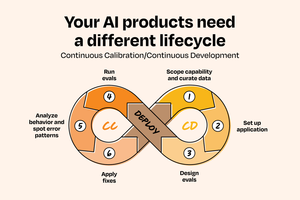

You can’t build AI products like other products.

AI products are inherently non-deterministic, and you need to constantly negotiate the tradeoff between agency and control.

When teams don’t recognize these differences, their products face unexpected failures, they're stuck debugging large complicated systems they can’t trace, and user trust in the product quietly erodes.

After seeing this pattern play out across 50+ AI implementations at companies including @OpenAI, @Google, @Amazon, and @Databricks, Aishwarya Naresh Reganti and Kiriti Badam developed a solution: the Continuous Calibration/Continuous Development (CC/CD) framework.

The name is a reference to Continuous Integration/Continuous Deployment (CI/CD), but, unlike its namesake, it’s meant for systems where behavior is non-deterministic and agency needs to be earned.

This framework shows you how to:

- Start with high-control, low-agency features

- Build eval systems that actually work

- Scale AI products without breaking user trust

It’s designed to recognize the uniqueness of AI systems and help you build more intentional, stable, and trustworthy AI products.

They're sharing it publicly for the first time:

66,95K

Top

Classificação

Favoritos